Intégrer l’IA dans la recherche universitaire

Quand et comment la déclarer et la citer dans vos publications ?

Les citations traditionnelles ne suffisent plus pour encadrer l’usage de l’IAg.

Ce billet est le dernier avant la saison estivale et le début d’une pause bien méritée avant le semestre d’automne. L’intelligence artificielle générative (IAg) a suscité beaucoup d’intérêt depuis janvier 2025, comme en témoignent la moitié de nos articles du Collimateur publiés jusqu’ici. Ce billet ne fait que confirmer que les changements en lien avec l’IAg se poursuivent sans cesse dans le milieu académique.

De plus en plus, on a vu émerger de nombreuses initiatives locales et interordres, comme les communautés de pratique (CoP) dans l’enseignement, mais aussi, à un degré moindre, dans les groupes spécialisés en recherche universitaire.

Par exemple, dans le cadre de l’une d’entre elles, la Communauté de pratique de la Faculté des sciences de l’éducation de l’UQAM sur l’intelligence artificielle (CoPIA), nous présentons dans ce billet deux textes qui ont été soumis à la réflexion sur l’utilisation croissante de l’IA générative, qui transforme inévitablement les pratiques de recherche et de publication académique.

Les deux publications proposent des cadres distincts, mais complémentaires pour guider la déclaration éthique de cet usage.

Un problème de fond mis en évidence par les deux publications

« In the past two years, publishers and authoritative organizations have developed different and sometimes contradictory disclosure policies. » (Resnik & Hossein 2025, p. 2)

Les deux textes partent du même constat : les citations traditionnelles ne suffisent plus pour encadrer l’utilisation de l’IA.

- Weaver l’explique clairement et cite d’emblée la Pre Rosemary Wette : « Unfortunately, citations do not fully meet the needs of today’s AI-enabled world. Citations emphasize the fixed form of a tangible output. En revanche, les outils génératifs produisent des résultats « uniques » et « souvent non reproductibles ». (Weaver 2024, p. 407)

- Resnik et Hosseini confirment cette difficulté en soulignant que les éditeurs ont adopté « des politiques différentes et parfois contradictoires », ce qui engendre de l’incertitude pour les équipes de recherche.

1 – Les critères de Weaver — Le cadre AID pour déclarer l’usage de l’IA

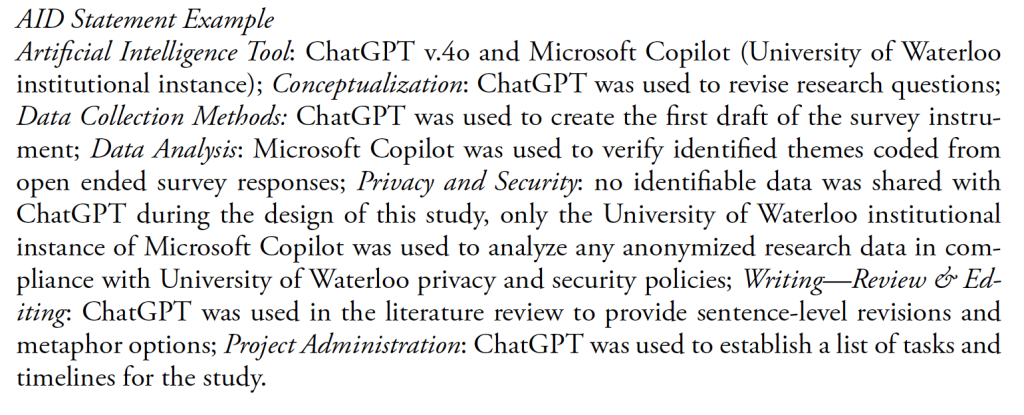

Weaver propose une méthode simple et structurée appelée AID (Artificial Intelligence Disclosure). Elle s’inspire des taxonomies de contributions (CRediT) et vise à rendre visible l’usage de l’IA dans toutes les étapes du processus de recherche sans alourdir inutilement la publication.

AID Statement: Artificial Intelligence Tool: [description of tools used]; [Heading]: [description of AI use in that stage of the work]

(Weaver 2024, p. 408)

Le principe est simple : « assurer la transparence dans l’utilisation des outils d’IAg durant le processus d’écriture ». Le cadre AID se fonde sur 14 catégories de déclaration d’utilisation, qui abordent les principales étapes d’un projet de recherche. (La traduction ci-dessous a été effectuée avec Claude 4.0 Sonnet.)

L’ensemble prend la forme d’une déclaration concise à la fin de l’article, semblable à une section de remerciements. L’objectif est de faciliter la transparence, sans alourdir la lecture.

2 – Les critères de Resnik et Hosseini — Quand déclarer ou non l’usage de l’IA ?

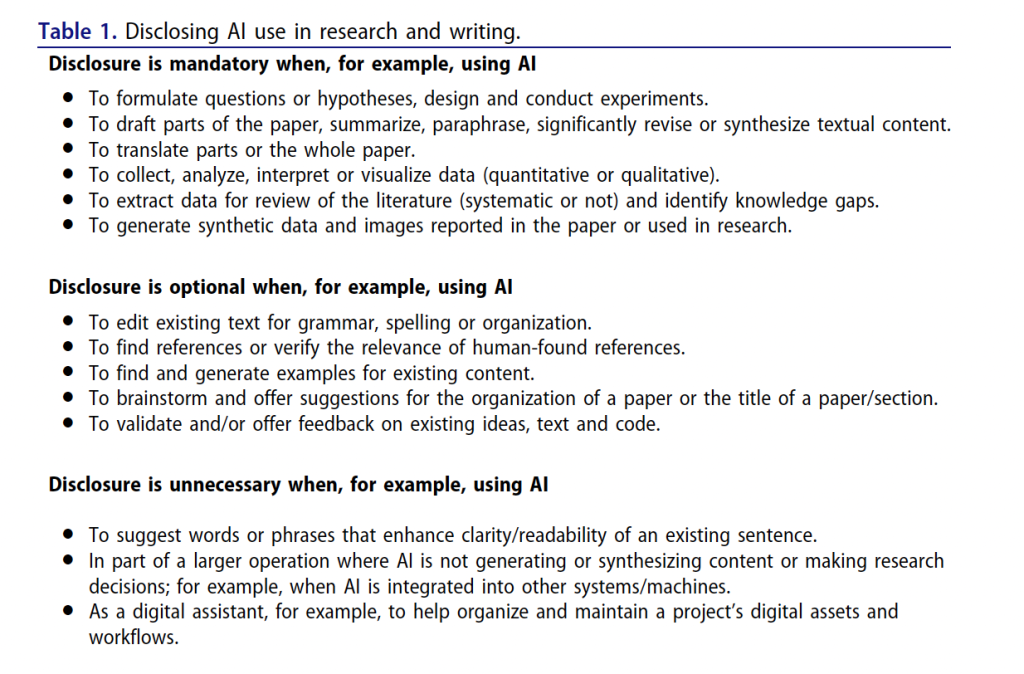

Resnik et Hosseini abordent la question sous un autre angle : quand la déclaration de l’usage de l’IA est-elle vraiment nécessaire ?

Leur réponse : « La divulgation devrait être obligatoire seulement quand l’usage de l’IA est intentionnel et substantiel ». (Resnik & Hosseini 2025, p. 5)

Ils proposent trois critères pour identifier les utilisations substantielles des outils d’IA dans la recherche. Dans tous ces cas, l’IA a un impact direct sur les résultats ou les conclusions.

Resnik et Hosseini proposent une approche nuancée pour les autres cas possibles. Ils tiennent compte du fait que certaines équipes de recherche peuvent vouloir divulguer leur usage d’outils IA par précaution, même quand ce n’est pas strictement nécessaire, pour éviter des questionnements ultérieurs sur l’intégrité de leur travail.

Pour répondre à cette complexité, ils proposent un système à trois niveaux :

Les auteurs justifient cette dernière catégorie par un argument pragmatique important : les divulgations triviales peuvent créer un « bruit » qui masque les usages vraiment significatifs de l’IAg. En effet, quand un article contient 25 mentions d’usages mineurs, l’usage réellement important peut passer inaperçu. De plus, l’obligation de tout divulguer peut s’avérer si laborieuse qu’elle finit par décourager la transparence.

Cette approche équilibrée vise à maintenir la transparence nécessaire sans entrer dans une surcharge d’information qui nuirait à l’objectif même de la divulgation.

Les points à retenir

Transparence avant tout

Les deux approches accordent une grande importance à la transparence. Weaver souhaite maintenir l’éthique académique et de la recherche, tandis que Resnik et Hosseini insistent sur les valeurs de transparence, d’honnêteté et de responsabilité.

L’IA n’est pas autrice

Les deux textes sont catégoriques : même si l’IA contribue au travail, elle ne peut pas être reconnue comme coautrice. Comme le rappellent Resnik et Hosseini, « Giving credit to an AI tool does not imply that the tool is an author ». (Resnik & Hossein 2025, p. 3)

Nécessité de s’adapter en recherche

Tous conviennent que les pratiques doivent être évolutives. Weaver souligne que le domaine de l’IA connaît une croissance rapide, alors que Resnik et Hosseini recommandent quant à eux de rester calmes et de laisser évoluer sa position.

… et concrètement pour la recherche universitaire

1- Documentez tout usage significatif

Bien que les politiques des revues diffèrent, il est préférable d’adopter une approche prudente et transparente.

2- Distinguez les usages mineurs des usages substantiels

Faire corriger votre grammaire par un outil d’IA n’est pas comparable à utiliser l’IA pour interpréter vos données.

3- Adaptez-vous aux exigences de votre domaine

Les attentes diffèrent selon les disciplines. Certaines demandent davantage de précision, tandis que d’autres se contentent de moins de détails.

4- Restez informé·e

Les politiques éditoriales évoluent rapidement. Les normes d’aujourd’hui peuvent être obsolètes demain.

Comme le concluent Resnik et Hosseini, « the use of AI in research continues to evolve in response to advancements in this technology » (Resnik & Hossein 2025, p. 10), ce qui exige une adaptation constante et nécessaire des pratiques de la recherche universitaire.

Bibliographie

David B. Resnik & Mohammad Hosseini (24 Mar 2025): Disclosing artificial intelligence use in scientific research and publication: When should disclosure be mandatory, optional, or unnecessary?, Accountability in Research, DOI: https://doi.org/10.1080/08989621.2025.2481949

Weaver, K. D. (2024). The artificial intelligence disclosure (AID) framework: An introduction. C&RL News, 85(10), 407-411. https://crln.acrl.org/index.php/crlnews/article/view/26548