DraftMarks, une alternative future au détecteur d’IAg

Plus un outil de transparence de la pensée, que de surveillance

Quand le texte ne dit plus qui de la personne étudiante ou de l’outil d’IA générative l’a rédigé…

Le problème que tout le monde connait et que DraftMarks tente de résoudre.

Lorsqu’une personne enseignante lit un travail de semestre à évaluer, elle ne lit pas seulement ce qui est dit. Elle lit également la trace d’une pensée en train de se former : les hésitations, les reformulations, le choix des mots, les transitions laborieuses. Ce processus de lecture repose sur un contrat tacite avec sa classe : le texte doit refléter l’effort cognitif de l’étudiant ou de l’étudiante pour attester de l’atteinte des objectifs du cours.

L’IA générative rompt ce contrat. Un texte fluide, structuré, exempt de maladresses peut désormais provenir d’un effort humain minimal. Les outils de détection d’IA générative (IAg) tentent de quantifier l’apport de texte ainsi généré, mais leur fiabilité reste limitée. Mais surtout, ils n’aide pas à répondre aux questions pédagogiques clés en lien avec l’évaluation. Comment la personne étudiante a-t-elle réfléchi ? Quelles décisions a-t-elle prises ? Quelle est la paternité réelle de son texte ?

Quand le texte ne dit plus qui a rédigé quoi

Depuis l’émergence des outils d’IA générative, les établissements d’enseignement cherchent des moyens de distinguer l’effort intellectuel réel du délestage cognitif par la délégation algorithmique. De plus, des outils de type « AI Humanizer », comme QuillBot ou Decopy.ai, permettent de reformuler en quelques secondes un texte d’origine algorithmique. Ces outils essaient de contourner les systèmes de détection d’IA en analysant les structures syntaxiques caractéristiques des grands modèles de langage et en les remplaçant par des tournures plus naturelles. Ils ne modifient pas le sens du contenu, rendant la détection encore plus difficile.

L’autre solution consiste à exiger le dépôt des historiques de conversation de la personne étudiante avec l’IAg en annexe du travail. Cette approche est plus précise, mais elle crée un autre problème : la personne enseignante qui évalue doit naviguer entre les documents pour reconstituer la genèse du texte, ce qui alourdit considérablement sa charge de travail. Aucune des deux solutions ne résout vraiment la question centrale : comment ce texte a-t-il été élaboré par la personne apprenante ?

Un outil de transparence du processus d’écriture

« DraftMarks works to repair the tacit contract between a reader and writer. » (Coscia, 2026)

DraftMarks est un outil expérimental de lecture augmentée développé par une équipe de recherche du Georgia Institute of Technology et de l’Université Stanford. Il a été présenté à CHI 2026 (document PDF, 25 Mo), la conférence de référence en interaction humain-machine de l’Association for Computing Machinery. Selon Adam Coscia, membre de l’équipe de recherche, l’objectif principal de cet outil est de rétablir le contrat tacite entre lentre les lecteur·trices et les auteur·trices(Coscia, 2026).

Cette intention est importante, mais elle nécessite une précision. DraftMarks ne prétend pas être un outil neutre. Il rend visible le processus de rédaction hybride et fournit nécessairement des informations qui peuvent être utilisées à des fins formatives (pour accompagner) ou à des fins sommatives (pour sanctionner). Sa valeur pédagogique dépend donc directement du cadre de référence institutionnel dans lequel il est déployé et des intentions qui guident son utilisation. L’outil n’est pas intrinsèquement bienveillant ou répressif ; c’est son utilisation qui l’est.

L’idée centrale : intégrer directement les traces dans le texte

DraftMarks permet une évaluation axée sur le processus plutôt que sur la seule détection d’un résultat final.

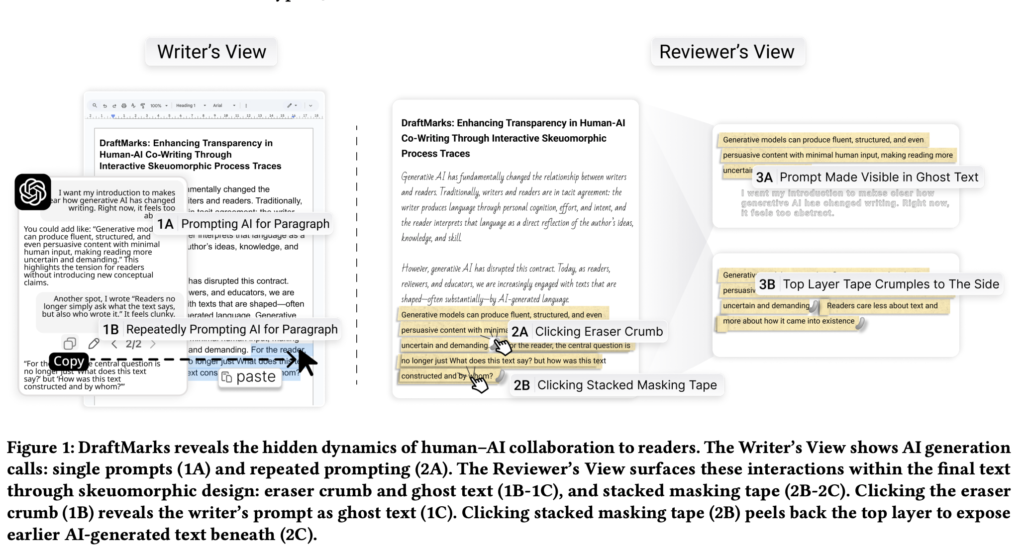

DraftMarks adopte une approche fondamentalement différente. Au lieu d’analyser le texte une fois qu’il est soumis, le système enregistre tout ce qui se passe pendant la rédaction, directement dans un éditeur de texte dédié. Chaque interaction avec l’IAg (soumission d’une requête, génération d’un texte, acceptation ou refus d’une suggestion, demande de changement de style) est captée et affichée sous forme de marqueurs visuels directement sur le document.

Techniquement, le système utilise la structure hiérarchique des éditeurs de texte pour conserver un historique chronologique des interactions entre l’humain et l’IAg. Différentes vues (voir image ci-dessous) traduisent ensuite ces métriques en marqueurs visuels qui sont directement superposés sur le texte.

© 2026 Copyright held by the owner/author(s).

ACM ISBN 979-8-4007-2278-3/26/04

L’originalité de DraftMarks réside justement dans cette approche skeuomorphique (explications ci-dessous) : plutôt que de produire des rapports externes ou des tableaux de bord séparés, l’outil encode les traces du processus de rédaction hybride directement dans le texte final, au moyen de métaphores visuelles inspirées de l’écriture physique.

Sept types de marqueurs ont été développés :

- Le ruban adhésif (masking tape) : il signale les passages entièrement générés par l’IA générative.

- Les traces de frottement (smudges) indiquent qu’une modification de ton a été appliquée par l’IA générative sur un texte existant.

- La poussière de gomme (eraser crumbs) exprime l’intensité des corrections effectuées par la personne qui rédige face aux suggestions de l’IA générative.

- Le résidu adhésif (residual glue) indique les passages provenant d’outils d’IA générative initialement acceptés puis supprimés.

- Le contraste typographique distingue visuellement la police manuscrite (écriture humaine) de la police sans-sérif (écriture d’IA générative), de façon non intrusive.

- Les marques de pochoir (stencil marks) représentent les passages réécrits par l’humain à partir d’une suggestion de l’IA générative.

- Le texte fantôme (ghost text) révèle les suggestions d’outils d’IA générées, mais finalement non retenues par la personne qui rédige.

Ces marqueurs se superposent pour illustrer la complexité des interactions. Un passage peut ainsi porter simultanément les traces d’une génération IA, d’une révision intensive et d’une suggestion refusée.

Ce que la recherche démontre

L’équipe de recherche a d’abord mené une étude exploratoire auprès de 21 personnes réparties en trois profils (corps enseignant, évaluation par les pairs et lectorat général) afin d’ajuster les repères visuels aux besoins réels de chaque contexte d’évaluation. Les résultats ont montré que le corps enseignant valorise les traces détaillées pour soutenir l’évaluation formative, que l’évaluation par les pairs privilégie des informations minimales centrées sur la contribution intellectuelle, et que le lectorat général recherche des indicateurs d’authenticité. Il en ressort que les exigences en matière de transparence varient en fonction du public cible.

Dans une évaluation contrôlée auprès de 70 personnes, DraftMarks a été comparé à la méthode de référence (texte final plus historique de discussion en vue partagée). Les personnes utilisant DraftMarks ont mieux compris les dynamiques d’écriture hybride (amélioration significative sur les questions de compréhension, effet de grande taille selon l’étude). Elles ont également déclaré une expérience moins exigeante sur le plan cognitif et un score d’utilisabilité élevé.

Les personnes enseignantes cherchent à observer dans le travail qui a été remis où la personne apprenante a résisté, hésité, reformulé. Les moments où elle a refusé une suggestion et où la pensée s’est construite, même laborieusement. DraftMarks rend ainsi visible une chose que le texte final ne montre jamais : les modes d’engagement de la personne étudiante avec l’IAg.

DraftMarks met en évidence ce qui était auparavant invisible, même pour l’auteur ou l’autrice en question. De plus, il incite la personne apprenante à analyser sa propre méthode d’écriture, indépendamment de toute évaluation.

Pour illustrer cette différenciation, l’équipe de recherche a élaboré trois scénarios hypothétiques. Ce ne sont pas des cas empiriques observés, mais des portraits types destinés à montrer l’étendue des situations que DraftMarks permet de distinguer.

- Matilda utilise l’IA générative de manière ciblée, pour les transitions et les reformulations dans son texte, en révisant intensivement le reste. Les marqueurs témoignent d’un engagement authentique. La réflexion humaine a clairement guidé la rédaction, l’IA n’ayant joué qu’un rôle d’appui ponctuel.

- Lavender multiplie les demandes de rétroaction à l’IA de manière itérative et répétée, sans pour autant lui déléguer la rédaction. Les marqueurs révèlent un recours intensif à la validation externe : non pas une tentative de tricherie, mais une insécurité rédactionnelle que le produit fini ne laisse pas paraître. C’est précisément ce type de signal que DraftMarks rend visible, ce qui peut orienter un accompagnement pédagogique ciblé.

- Bruce délègue entièrement un paragraphe à partir d’un copier-coller de la consigne. Les marqueurs rendent immédiatement visible une délégation passive, en contradiction avec le processus d’apprentissage. Le texte est fluide, mais le processus est absent. C’est exactement la situation pour laquelle DraftMarks fournit les informations les plus utiles pour une évaluation.

Ces trois portraits types illustrent trois réalités distinctes : un usage expert, un usage révélateur d’un besoin de soutien, et un usage problématique. DraftMarks ne les traite pas de la même manière, et c’est précisément là sa valeur. Il permet une réponse pédagogique différenciée, là où un détecteur ne fournirait qu’un score global.

Pour un profil comme celui de Lavender, la recherche en interaction humain-machine apporte un éclairage utile. L’AI Ghostwriter Effect (Draxler et al., 2024) décrit la tendance de personnes qui rédigent à ne pas se sentir pleinement responsables du texte généré par l’IA, tout en évitant d’en divulguer l’usage. Ce n’est pas nécessairement de la malhonnêteté délibérée, mais plutôt un rapport ambigu et parfois inconscient à la paternité de l’œuvre, amplifié par l’absence de visibilité sur ce que l’IA a réellement produit.

Un prototype de recherche prometteur

DraftMarks est actuellement un prototype de recherche conçu pour être distribué sous licence ouverte. Il n’existe aucune version grand public disponible.

DraftMarks est un outil de transparence, et non de surveillance. Son déploiement requiert l’engagement clair et explicite des personnes concernées, ancré dans une politique institutionnelle claire.

C’est une première réponse concrète à un problème pédagogique réel. L’évaluation sommative de l’outil (n = 70) montre que les marqueurs améliorent la compréhension du processus de rédaction hybride et accroissent la transparence perçue sans surcharger cognitivement le lectorat.

Ces résultats sont encourageants, mais leur portée reste à confirmer sur des échantillons plus larges et dans des contextes disciplinaires variés.

L’efficacité de DraftMarks dépend moins de sa robustesse technique que du cadre pédagogique et du contrat tacite dans lesquels il est déployé.

Il présente aussi des limites à ne pas ignorer.

- Il fonctionne seulement si la personne étudiante rédige dans l’environnement dédié de DraftMarks.

- Il ne permet pas encore de distinguer si un passage généré par l’IA cite, paraphrase ou invente des sources.

- Les traces captées soulèvent des questions légitimes sur la confidentialité du processus d’écriture, que l’équipe a partiellement traitées par une fonction d’annotation volontaire des décisions.

La vision de l’équipe va au-delà de la salle de classe. Comme le formule Coscia : « We envision a future where anyone can reliably see where an author’s effort was in their writing. » Un avenir où la transparence du processus d’écriture deviendrait une norme de lecture applicable dans les contextes académiques, éditoriaux et professionnels.

Ce que DraftMarks esquisse, c’est peut-être une nouvelle forme de littératie de l’intelligence artificielle générative. Doit-on évaluer uniquement le produit final déposé en évaluation, ou également le processus de rédaction et la façon dont il témoigne de l’apprentissage de la personne étudiante ?

Références

Siddiqui, M. N., Nasseri, N., Coscia, A. J., Pea, R., et Subramonyam, H. (2026). DraftMarks : Enhancing transparency in human-AI co-writing through interactive skeuomorphic process traces. Dans Proceedings of the 2026 CHI Conference on Human Factors in Computing Systems (CHI ’26), Article 862 (p. 1-22). Association for Computing Machinery. https://doi.org/10.1145/3772318.3791109

Coscia, A. J. (2026, 6 avril). I’m super excited to share our co-authored #CHI2026 paper DraftMarks! Generative AI has fundamentally disrupted the tacit contract between writers and readers [Publication LinkedIn]. LinkedIn. https://www.linkedin.com/posts/adam-coscia_chi2026-chi-chi2026-share-7447293866203910144-2WYl

Draxler, F., Werner, A., Lehmann, F., Hoppe, M., Schmidt, A., Buschek, D., et Welsch, R. (2024). The AI ghostwriter effect: When users do not perceive ownership of AI-generated text but self-declare as authors. ACM Transactions on Computer-Human Interaction. https://doi.org/10.1145/3637875